Introducción a la entropía

Antecedentes

SOS ofrecen una descarga completa de esta selección de escuelas para su uso en escuelas intranets. Visite el sitio web de Aldeas Infantiles SOS en http://www.soschildren.org/

| Termodinámica | |||||||||||||||||||||

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

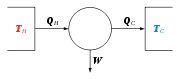

El motor térmico clásico Carnot | |||||||||||||||||||||

Ramas | |||||||||||||||||||||

Sistemas Estado: Ecuación de estado Gas Ideal · Gas real Fase de la materia · Equilibrio Control de volumen · Instrumentos Procesos: Isobárica · Isócoro · Isotérmico Adiabático · Isoentrópica · Isoentálpica Cuasiestática · Polytropic Expansión gratuito La reversibilidad · Irreversibilidad Endoreversibility Ciclos: Motores térmicos · Las bombas de calor Eficiencia térmica | |||||||||||||||||||||

Propiedades del sistema Diagramas de Propiedad Propiedades intensivas y extensivas Funciones de estado: Temperatura / Entropía (intro.) † Presión / † Volumen El potencial químico / Partículas no. † († Variables conjugadas) Título de vapor Propiedades reducidas Funciones de proceso: Trabajo · Calor |

|||||||||||||||||||||

Propiedades materiales

| |||||||||||||||||||||

Ecuaciones El teorema de Carnot · Clausius teorema · Relación fundamental · Ley de los gases ideales · Relaciones de Maxwell · Las relaciones recíprocas de Onsager · Ecuaciones termodinámicas de Bridgman Tabla de ecuaciones termodinámicas | |||||||||||||||||||||

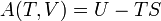

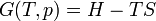

Potenciales La energía libre · Entropía gratuito

| |||||||||||||||||||||

Historia y cultura Filosofía: La entropía y el tiempo · Entropía y la vida Trinquete browniano El demonio de Maxwell Paradoja muerte Heat La paradoja de Loschmidt Sinergética Historia: Generales · Calor · Entropía · Leyes de los gases Movimiento continuo Teorías: Teoría calórica · Vis viva Teoría de calor Equivalente mecánico del calor La fuerza motriz Publicaciones: " Un Experimental Investigación sobre ... Heat " " En el equilibrio de sustancias heterogéneas " "Reflexiones sobre la Motive Poder del Fuego " Líneas de tiempo de: Termodinámica · Los motores térmicos Arte: Superficie termodinámica de Maxwell Educación: La entropía como dispersión de energía | |||||||||||||||||||||

La entropía es una medida de cómo se distribuye uniformemente la energía en un sistema. En una entropía sistema físico proporciona una medida de la cantidad de energía que no puede ser utilizado para hacer el trabajo .

Cuando el calor fluye desde una región caliente para una región fría entropía aumenta, ya que el calor se distribuye en todo el sistema. El concepto de entropía es central en la segunda ley de la termodinámica . La segunda ley determina que pueden ocurrir procesos físicos. Por ejemplo, se predice que el calor fluye de alta temperatura a baja temperatura en procesos espontáneos. La segunda ley de la termodinámica se puede plantear como diciendo que la entropía de un sistema aislado siempre aumenta, y los procesos que aumentan la entropía puede ocurrir espontáneamente. Desde la entropía aumenta a medida que aumenta la uniformidad, la segunda ley dice cualitativamente que incrementa la uniformidad.

El término entropía fue acuñado en 1865 por el físico alemán Rudolf Clausius, de las palabras griegas ES-, "en", y tropo "un giro", en analogía con la energía .

Explicación

El concepto de entropía termodinámica surge de la segunda ley de la termodinámica . Se utiliza entropía para cuantificar la capacidad de un sistema para el cambio, a saber, que el calor fluye desde una región de temperatura más alta a uno con temperatura más baja, y para determinar si se puede producir un proceso termodinámico.

La entropía se define por dos descripciones, primero como la relación entre el flujo macroscópico de calor en un sistema y el cambio del sistema de la temperatura, y la segunda, en un nivel microscópico, como el logaritmo natural del número de microestados de un sistema.

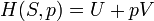

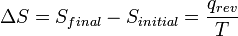

Siguiendo el formalismo de Clausius, la primera definición puede ser matemáticamente declaró como:

Donde d S es el cambio en la entropía y δ q es el calor añadido al sistema reversible. Si se permite que la temperatura para variar la ecuación debe ser integrada en la ruta de la temperatura. Esta definición de la entropía no permite la determinación de un valor absoluto, sólo las diferencias.

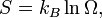

La segunda definición de la entropía viene de la mecánica estadística . La entropía de un particular, macroestado se define para ser Veces la constante de Boltzmann logaritmo natural del número de microestados correspondiente a la macroestado, o matemáticamente

Donde S es la entropía, k es la constante de Boltzmann, y omega es el número de microestados.

El macroestado de un sistema es lo que sabemos sobre el sistema, por ejemplo la temperatura , presión, y volumen de un gas en una caja. Para cada conjunto de valores de temperatura, presión y volumen que hay muchos arreglos de moléculas que dan lugar a esos valores. El número de arreglos de moléculas que podrían dar lugar a los mismos valores para la temperatura, la presión y el volumen es el número de microestados.

El concepto de energía está relacionada con la primera ley de la termodinámica , que trata de la conservación de la energía y en las que la pérdida de calor se traducirá en una disminución de la energía interna de la sistema termodinámico. Entropía termodinámica proporciona una medida comparativa de la cantidad de esta disminución de la energía interna del sistema y el correspondiente aumento en la energía interna de los alrededores a una temperatura dada. Una visualización sencilla y más concreto de la segunda ley es que la energía de todos los tipos de cambios está localizada a quedar dispersos o separados, si no está impedido de hacerlo. Cambio de entropía es la medida cuantitativa de ese tipo de un proceso espontáneo: la cantidad de energía ha fluido o qué tan ampliamente se ha convertido en extenderse a una temperatura específica.

La entropía se ha desarrollado para describir cualquiera de varios fenómenos, dependiendo del campo y el contexto en el que se está utilizando. Información entropía toma los conceptos matemáticos de la termodinámica estadística en las áreas de la teoría de probabilidades no relacionado con el calor y la energía.

Ejemplo de incremento de la entropía

De fusión del hielo es un ejemplo en el que la entropía aumenta en un pequeño sistema, un sistema termodinámico que consta de los alrededores (el cuarto caliente) y la entidad de envases de vidrio, hielo, agua, que le ha permitido llegar equilibrio termodinámico a la temperatura de fusión del hielo. En este sistema, algunos de calor (δQ) de los alrededores más cálidas a 298 K (77 ° F, 25 ° C) se transfiere al sistema de refrigeración de hielo y agua a su temperatura constante (T) de 273 K (32 ° F, 0 ° C), la temperatura de fusión del hielo. La entropía del sistema, que es δQ / T, aumenta en δQ / 273K. El δQ de calor para este proceso es la energía necesaria para cambiar el agua desde el estado sólido al estado líquido, y se llama la entalpía de fusión, es decir,? H para la fusión de hielo.

Es importante darse cuenta de que la entropía de la habitación circundante disminuye a menos de la entropía del hielo y agua aumenta: la temperatura ambiente de 298 K es mayor que 273 K y por lo tanto la relación, (cambio de entropía), de δQ / 298K para los alrededores es menor que la relación (variación de entropía), de δQ / 273K para el sistema de hielo y agua. Esto siempre es cierto en eventos espontáneos en un sistema termodinámico y muestra la importancia de predicción de la entropía: la entropía neto final después de un evento de este tipo es siempre mayor que era la entropía inicial.

Como la temperatura del agua fría se eleva a la de la habitación y la habitación se enfría aún más imperceptible, la suma de la δQ / T en el rango continuo ", en muchos incrementos", inicialmente en el agua fría o caliente, finalmente, puede ser encontrada por cálculo. La miniatura entera 'universo', es decir, este sistema termodinámico, se ha incrementado en la entropía. La energía se ha convertido de forma espontánea más disperso y diseminado en ese "universo" que cuando se introdujo el cristal de hielo + agua y se convirtió en un "sistema" en su interior.

Orígenes y usos

Originalmente, la entropía fue nombrado para describir el calor residual, o más exactamente las pérdidas de energía, de los motores de calor y otros dispositivos mecánicos que nunca podrían funcionar con una eficiencia del 100% en la conversión de la energía en trabajo. Más tarde, el término llegó a adquirir varias descripciones adicionales a medida que más llegó a entenderse sobre el comportamiento de las moléculas en el nivel microscópico. En el siglo 19 la palabra "trastorno" fue utilizado por Ludwig Boltzmann en el desarrollo vistas estadísticas de entropía utilizando teoría de la probabilidad para describir el aumento del movimiento molecular en el nivel microscópico. Eso fue antes de que el comportamiento cuántico llegó a ser mejor entendido por Werner Heisenberg y los que siguieron. Descripciones de termodinámica (calor) de entropía en el nivel microscópico se encuentran en termodinámica estadística y la mecánica estadística .

Durante la mayor parte del siglo 20 libros de texto tienden a describir la entropía como "desorden", siguiendo la conceptualización temprana de Boltzmann de la energía motional de moléculas. Más recientemente ha habido una tendencia en los libros de texto de química y física para describir la entropía en términos de "la dispersión de la energía". La entropía también puede implicar la dispersión de las partículas, que son a su vez lleno de energía. Así, hay casos en los que ambas partículas y energía dispersan a diferentes velocidades cuando las sustancias se mezclan juntos.

Las matemáticas desarrolladas en termodinámica estadística resultaron ser aplicable en otras disciplinas. En particular, ciencias de la información desarrollaron el concepto de entropía de información, donde una constante sustituye a la temperatura que es inherente a la entropía termodinámica.

El calor y la entropía

A nivel microscópico, la energía cinética de las moléculas es responsable de la temperatura de una sustancia o de un sistema. "Heat" es la energía cinética de las moléculas de ser transferido: cuando la energía se transfiere de motional entorno más caliente a un sistema de enfriador, las moléculas de movimiento más rápido en los alrededores chocan con las paredes del sistema que transfiere parte de su energía a las moléculas del sistema y hace que se muevan más rápido.

- Las moléculas en un gas como el nitrógeno a temperatura ambiente en cualquier instante se están moviendo a una velocidad media de casi 500 kilómetros por hora (210 m / s), chocando repetidamente y por lo tanto el intercambio de energía para que sus velocidades individuales siempre están cambiando, incluso estando inmóvil un instante si dos moléculas con exactamente la misma velocidad chocan de frente, antes de que otra molécula de los golpea y que la raza fuera, tan rápido como 2.500 millas por hora. (A temperaturas más altas velocidades medias aumentan y energía motional convierte proporcionalmente mayor.)

- Por lo tanto la energía molecular motional ("energía de calor ') de los alrededores más calientes, como las moléculas más rápido se mueve en una llama o violentamente vibrante átomos de hierro en una placa caliente, se fundirá o hervir una sustancia (el sistema) a la temperatura de su punto de fusión o de ebullición . Esa cantidad de energía motional de los alrededores que se requiere para la fusión o de ebullición se llama la energía de cambio de fase, específicamente la entalpía de fusión o de vaporización, respectivamente. Esto rompe la energía de cambio de fase enlaces entre las moléculas en el sistema (no los enlaces químicos dentro de las moléculas que sostienen los átomos juntos) en lugar de contribuir a la energía motional y haciendo las moléculas se mueven más rápido - por lo que no elevan la temperatura, pero en cambio permite que las moléculas de liberarse a moverse en forma líquida o en forma de vapor.

- En términos de energía, cuando un sólido se convierte en un líquido o un líquido a vapor, la energía motional procedente de los alrededores se cambia a 'energía potencial' en la sustancia (energía de cambio de fase, que se libera de nuevo a los alrededores cuando el entorno se vuelven más frío de ebullición o temperatura de fusión de la sustancia, respectivamente). Cambio de fase de energía aumenta la entropía de una sustancia o sistema, ya que es la energía que debe ser hacia fuera en el sistema de los alrededores de modo que la sustancia puede existir como un líquido o vapor a una temperatura superior a su punto de fusión o de ebullición. Cuando este proceso se produce en un "universo" que consiste en los alrededores además el sistema, la energía total del universo se hace más dispersa o se extendió a cabo como parte de la mayor energía que sólo fue en los alrededores más calientes transferencias de modo que algunos se encuentra en el sistema de enfriamiento. Esta dispersión de energía aumenta la entropía del 'universo'.

El principio general importante es que "la energía de todo tipo cambia de ser localizado para quedar dispersos o separados, si no está impedido de hacerlo. La entropía (o mejor, el cambio de entropía) es la medida cuantitativa de ese tipo de un proceso espontáneo: la cantidad de energía que se ha transferido / T o qué tan ampliamente se ha convertido en extenderse a una temperatura específica.

Cálculo clásico de la entropía

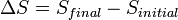

Cuando la entropía se define y utiliza en el año 1865 por primera vez la existencia de los átomos era aún controversial y no existía el concepto de que la temperatura se debe a la energía motional de moléculas o que "el calor" fue en realidad la transferencia de esa energía molecular motional de un lugar a otra. Cambio de entropía,  , Fue descrito en términos macroscópicos que podrían medirse directamente, como el volumen, la temperatura o la presión. Sin embargo, hoy la ecuación clásica de la entropía,

, Fue descrito en términos macroscópicos que podrían medirse directamente, como el volumen, la temperatura o la presión. Sin embargo, hoy la ecuación clásica de la entropía,  puede explicarse, parte por parte, en términos modernos describiendo cómo las moléculas son responsables de lo que está ocurriendo:

puede explicarse, parte por parte, en términos modernos describiendo cómo las moléculas son responsables de lo que está ocurriendo:

es el cambio en la entropía de un sistema (una sustancia física de interés) después de un poco de energía motional ("calor") ha sido transferida por moléculas que se mueven rápido. Por lo tanto,

es el cambio en la entropía de un sistema (una sustancia física de interés) después de un poco de energía motional ("calor") ha sido transferida por moléculas que se mueven rápido. Por lo tanto,  .

.

- Luego,

, El cociente de la energía motional ("calor") q que se transfiere "reversible" (rev) para el sistema de los alrededores (o de otro sistema en contacto con el primer sistema) dividido por T, la temperatura absoluta a la que el transferencia ocurre.

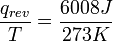

, El cociente de la energía motional ("calor") q que se transfiere "reversible" (rev) para el sistema de los alrededores (o de otro sistema en contacto con el primer sistema) dividido por T, la temperatura absoluta a la que el transferencia ocurre. - "Reversible" o "reversible" (rev) simplemente significa que T, la temperatura del sistema, tiene que quedarse (casi) exactamente de la misma mientras que cualquier energía está siendo transferida hacia o desde ella. Eso es fácil en el caso de cambios de fase, donde el sistema absolutamente debe mantenerse en forma sólida o líquida hasta que haya suficiente energía se da a él para romper los enlaces entre las moléculas antes de que pueda cambiar a un líquido o un gas. Por ejemplo, en la fusión del hielo a 273,15 K, no importa lo que la temperatura de los alrededores son - desde 273.20 K a 500 K o incluso superior, la temperatura del hielo permanecerá a 273,15 K hasta las últimas moléculas en el hielo se cambian a líquido agua, se forman enlaces de hidrógeno es decir, hasta que todos los enlaces de hidrógeno entre las moléculas de agua en hielo se rompen y lo nuevo, fijos menos, exactamente entre las moléculas de agua líquida. Esta cantidad de energía necesaria para la fusión del hielo por mol se ha encontrado para ser 6008 joules a 273 K. Por lo tanto, el cambio de entropía por mol es

, O 22 J / K.

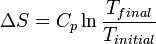

, O 22 J / K. - Cuando la temperatura no es en el punto de fusión de una sustancia o de ebullición No hay ruptura de enlaces intermolecular es posible, y por lo que cualquier energía molecular motional ("calor") de los alrededores transferidos a un sistema eleva su temperatura, haciendo que sus moléculas se mueven más rápido y más rápido. A medida que la temperatura aumenta constantemente, ya no es un valor particular de "T" en el que se transfiere energía. Sin embargo, una transferencia de energía "reversible" se puede medir en un muy pequeño aumento de la temperatura, y un total acumulado se puede encontrar mediante la adición de cada uno de muchos intervalos de temperatura pequeños o incrementos. Por ejemplo, para encontrar la variación de entropía

de 300 K a 310 K, medir la cantidad de energía transferida a decenas o cientos de incrementos de temperatura, digamos de 300,00 K a 300,01 K y luego 300,01 a 300,02 y así sucesivamente, dividiendo el q por cada uno de T, y finalmente la adición de todos ellos.

de 300 K a 310 K, medir la cantidad de energía transferida a decenas o cientos de incrementos de temperatura, digamos de 300,00 K a 300,01 K y luego 300,01 a 300,02 y así sucesivamente, dividiendo el q por cada uno de T, y finalmente la adición de todos ellos. - Cálculo se puede utilizar para hacer este cálculo más fácil si el efecto de la entrada de energía al sistema es linealmente dependiente de el cambio de temperatura, como en simple calentamiento de un sistema a temperaturas moderadas a relativamente alta. Así, la energía que se transfiere "per cambio incremental en la temperatura" (la capacidad calorífica,

), Multiplicado por la integral de

), Multiplicado por la integral de  desde

desde  a

a  , Está directamente determinado por

, Está directamente determinado por  .

.

- "Reversible" o "reversible" (rev) simplemente significa que T, la temperatura del sistema, tiene que quedarse (casi) exactamente de la misma mientras que cualquier energía está siendo transferida hacia o desde ella. Eso es fácil en el caso de cambios de fase, donde el sistema absolutamente debe mantenerse en forma sólida o líquida hasta que haya suficiente energía se da a él para romper los enlaces entre las moléculas antes de que pueda cambiar a un líquido o un gas. Por ejemplo, en la fusión del hielo a 273,15 K, no importa lo que la temperatura de los alrededores son - desde 273.20 K a 500 K o incluso superior, la temperatura del hielo permanecerá a 273,15 K hasta las últimas moléculas en el hielo se cambian a líquido agua, se forman enlaces de hidrógeno es decir, hasta que todos los enlaces de hidrógeno entre las moléculas de agua en hielo se rompen y lo nuevo, fijos menos, exactamente entre las moléculas de agua líquida. Esta cantidad de energía necesaria para la fusión del hielo por mol se ha encontrado para ser 6008 joules a 273 K. Por lo tanto, el cambio de entropía por mol es

Descripciones introductorias de entropía

Tradicionalmente, los libros de texto del siglo 20 han introducido entropía como orden y el desorden de modo que proporciona "una medida de la aleatoriedad trastorno o de un sistema". Se ha sostenido que las ambigüedades en los términos utilizados (como "desorden" y el "caos") contribuyen a la confusión generalizada y pueden dificultar la comprensión de la entropía para la mayoría de los estudiantes. Una formulación más reciente asociado con Frank L. Lambert describiendo entropía como dispersión de energía describe la entropía como medir "la dispersión espontánea de la energía - a una temperatura específica."